Si alguna vez has chateado con un asistente virtual (chatbot) como ChatGPT, Gemini u otro, quizás te ha pasado que te da una respuesta que suena convincente pero notas que algo no cuadra. Puede ser una fecha que no existe, un autor inventado, o simplemente una afirmación que no puedes verificar. Eso tiene nombre: alucinaciones de IA. En esta entrada vamos a explicar ambas cosas: qué son los chatbots, qué son las alucinaciones de IA, cómo se relacionan, por qué ocurren, riesgos y qué hacer para reducirlas.

Pero, ¿que es un chatbot y porqué las alucinaciones son tan influyentes?

Un chatbot es un programa de ordenador que simula una conversación con personas. Se puede usar para responder preguntas, ayudar con tareas, dar soporte, contar chistes, etc. Usa modelos de lenguaje (LLM) entrenados con muchos textos para generar respuestas que parezcan humanas. Estos pueden entrenarse con grandes cantidades de datos (lo cual puede ser muy costoso) o usar modelos pre-entrenados -GPT, Gemini, Claude,… – proporcionándoles ejemplos sobre qué acciones pueden hacer o qué pueden responder.

Debido a ese mecanismo probabilístico, no siempre tiene datos reales para todo, y ahí empiezan los «rellenos», errores o alucinaciones de la IA, cuando intenta completar lo que no sabe. Así pues, las alucinaciones son declaraciones o fragmentos generados por modelos de lenguaje que son verosímiles pero falsos o no verificados.

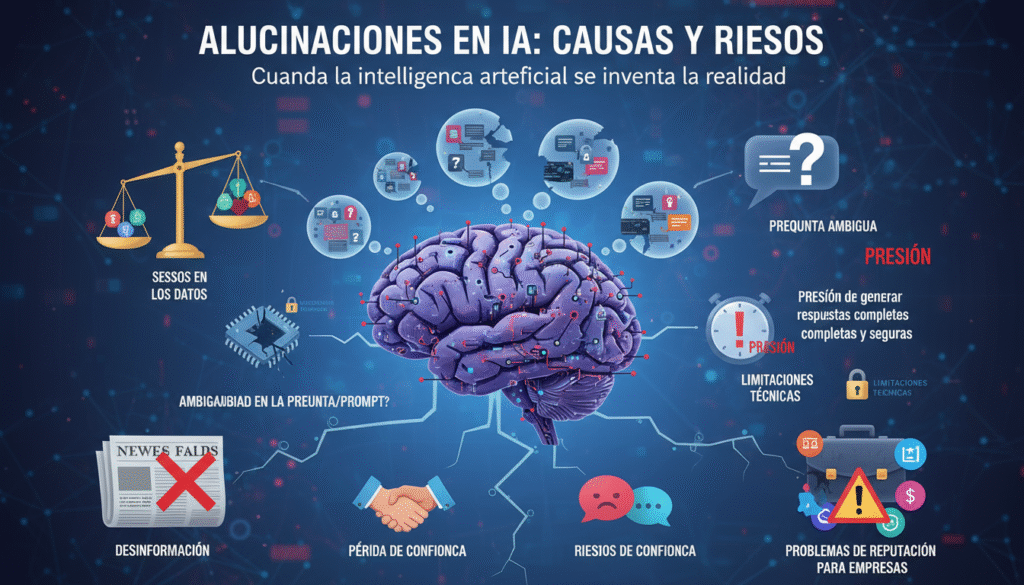

¿Qué causan estas alucinaciones y cuáles son sus riesgos?

Por desgracia, no existe una causa exacta que sea indicativo del porqué se está produciendo una alucinación, pero hay algunas patrones que pueden ser comunes estas oraciones que pueden tener sentido pero son «falsas». Por ejemplo:

- Falta de información fiable o lagunas en los datos de entrenamiento. Si algo no estaba en los textos con los que se ha entrenado o visto, puede inventarse basándose en patrones similares.

- Sesgos en los datos: si los ejemplos del entrenamiento tienen errores, imprecisiones o están centrados solo en ciertos idiomas o culturas, el chatbot puede repetir esos sesgos.

- Ambigüedad en la pregunta/prompt: si lo que pide el usuario no es claro, el chatbot interpreta según lo que cree más probable, lo que puede llevar a errores.

- Presión de generar respuestas completas y seguras: los modelos muchas veces están optimizados para responder de forma confiada, incluso si no deberían estar tan seguros. Esto puede aumentar las alucinaciones.

- Limitaciones técnicas: tamaño del modelo, capacidad de memoria, acceso a fuentes de conocimiento actuales, etc.

Esto mismo lo podemos extrapolar a las imágenes: te genera imágenes que un principio pueden parecer verosímiles, pero cuando miras más de cerca te percatas de detalles que solamente una IA haría. Para un ejemplo, la siguiente imagen:

¿Tu primera vistazo ha sido de una imagen normal pero después cuando has ido a analizar con más atención cada parte, posiblemente leyendo los textos, te has extrañado? No pasa nada, no estás solo. A todos nos ha pasado con este tipo de imágenes.

A primera impresión, la imagen anterior puede parecer realista y bien hecha, pero cuando nos fijamos en los detalles, vemos que las palabras están mal escritas o que las letras ni siquiera existen. Pues en los textos, puede ocurrir lo mismo.

Esto, provoca algunas consecuencias que pueden ser bastante graves, dependiendo del contexto en el que nos encontremos, como:

- Desinformación: usuarios pueden creer algo falso pensando que es cierto.

- Pérdida de confianza: si alguien usa un chatbot para información importante y falla, deja de creer en la herramienta.

- Riesgos legales o profesionales: si alguien usa datos falsos en un informe, en medicina, derecho, etc.

- Problemas de reputación para empresas que usan chatbots públicos.

Y…, ¿cuándo nos deben saltar las alarmas de que la IA probablemente esté alucinando?

Pues la respuesta es sencilla, y se asemeja mucho al comportamiento humano. Cuando no ofrece fuente, cuando la respuesta es muy específica pero sin respaldo, cuando notas contradicciones o fechas/objetos imposibles o poco probables. También si la pregunta es técnica, especializada, reciente (actualidad) o poco documentada.

Cuando estas alarmas saltan, podemos usar alguna de estas estrategias (o todas, cuanto más azúcar más dulce) con el objetivo de mitigar este efecto:

- Entrenar con datos más recientes, fiables y variados.

- Incorporar mecanismos de recuperación de hechos: usar bases de datos confiables o sistemas que, antes de generar la respuesta, verifiquen hechos («retrieval augmented generation, RAG«).

- Pedir al chatbot que cite fuentes o que indique su nivel de certeza.

- Diseñar prompts claros, concretos, con contexto suficiente.

- Añadir supervisión humana (RLHF), especialmente en aplicaciones sensibles.

- Evaluaciones continuas, pruebas de errores, ajustes del modelo (fine-tuning).

¿Llegará al punto de que se puede «enseñarles» a no alucinar o directamente no alucine?

Una pregunta que se nos suele hacer mucho cuando hablamos de este tipo de temas es que ante este escenario de mejora continua en el mundo de la IA. La respuesta es clara: sí, pueden mejorar mucho, pero no es probable que desaparezcan por completo los errores porque los modelos solo pueden usar lo que han aprendido, los datos disponibles, y cómo están diseñados. Pero con buenas prácticas se pueden minimizar bastante.

Por lo tanto, los chatbots y alucinaciones de IA van de la mano: no puedes hablar de uno sin el otro en el contexto moderno. Los chatbots son herramientas muy poderosas, útiles para muchas cosas, pero tienen limitaciones reales. Entender esas limitaciones, reconocer cuándo una respuesta puede ser dudosa, y usar estrategias para reducir errores es clave si queremos sacar lo mejor de estas tecnologías sin caer en engaños o errores evitables.

¿Te gustaría probar cómo funciona un chatbot mitigando las alucinaciones al máximo? Prueba nuestro asistente conversacional para teléfonos, webs y WhatsApp, y comprueba por ti mismo todo lo que puede hacer por tu negocio. ¡Contáctanos!